Last Updated 12. März 2021

Jetzt wird es heftig. Dieser Artikel erschien bereits am 8. Aug. 2019, verliert aber nicht an Aktualität, zumal sich nun herausstellt, einem der im Artikel genannten Professoren muss nun auch unterstellt werden, er hat auch Interesse an dieser Desinformation. Dazu gibt es ganz unten einen Hinweis auf einen neuen Artikel der bald kommt.

“Die Heidelberger Stellungnahme: Physiker sezieren Energiewende”

schreibt der rechte Onlineblog AchGut, den Hendrik M. Broder betreibt. Gunter Frank ist der Gastautor und die gesammelte Klimaskeptikergemeinde jubelt.

Worum geht es?

Drei Uni-Professoren des physikalischen Institut der Universität Heidelberg gaben auf der Homepage ihres Institutes eine bemerkenswerte Stellungnahme ab. Titel ihrer Studie: Energiewende: Fakten, Missverständnisse, Lösungen. Klickt man auf den Link bei AchGut, so bekommt man ein PDF-Dokument angezeigt vom 15.07.2019.

Drei Uni-Professoren des physikalischen Institut der Universität Heidelberg gaben auf der Homepage ihres Institutes eine bemerkenswerte Stellungnahme ab. Titel ihrer Studie: Energiewende: Fakten, Missverständnisse, Lösungen. Klickt man auf den Link bei AchGut, so bekommt man ein PDF-Dokument angezeigt vom 15.07.2019.

Wir lesen:

Die Energiewende soll den fortschreitenden Klimawandel aufhalten. Zu diesem Zweck hat sich Deutschland im Klimapakt der Europäischen Union verpflichtet, den Ausstoß klimaschädlicher Gase bis 2050 um 80% bis 95% zu verringern. Als Zwischenziel soll laut Bundesministerium für Umwelt (BMU) bis 2030, das heißt in etwa zehn Jahren, deren Ausstoß gegenüber heute um gut 40% gesenkt werden. N.B.: Quellen zu allen Angaben in diesem Text finden sich in einer separaten Excel-Datei unter:

https://www.physi.uni-heidelberg.de/energiewende/Quellenangaben_Web_2019.xlsFakten

Um abschätzen zu können, wie realistisch dieses 40%-Zwischenziel ist, muss man als erstes einen Blick zurückwerfen: Was wurde in der gleichen Zeitspanne, d.h. in den vergangenen zehn Jahren, beim Klimaschutz in Deutschland erreicht, nachdem erheblich in den Ausbau von Wind und Sonnenkraftanlagen investiert wurde? Die Antwort fällt ernüchternd aus – der Ausstoß klimaschädlicher Gase ist seither unverändert, abgesehen von kleinen zufälligen Schwankungen.

Die Uni veröffentlicht das wirklich

Und tatsächlich finden wir genau dieses PDF auf der Seite der Uni verlinkt. Aber wenn man sich das genauer anschaut, dann strotzt das Dokument nur so von Fehlern. Die Professoren, Prof. Dr. Dr. h.c. Dirk Dubbers, Prof. Dr. Johanna Stachel, Prof. Dr. Ulrich Uwer, sind Physiker/innen. Aber bei der Art der Fehler, die ich im weiteren auszugsweise untersuche, kann man auf den ersten Blick nur zu dem Urteil kommen, das müssen Missverständnisse sein. Auf den zweiten Blick wird einem klar, da wird so unsauber gearbeitet, dass auch Studenten sofort protestieren müssten. Was soll dieses Machwerk denn bezwecken? Das was es macht, es schädigt die ganze Reputation des Institutes. Aber Eins nach dem Anderen.

Auch das Lobby-Institut EIKE informiert über die Stellungnahme und hier lesen wir…

Im Jahre 2017 erschien auf der Webseite der Universität Heidelberg ein kurzer Aufsatz unter dem Titel „Findet eine Energiewende überhaupt statt“? Der Aufbau dieses Aufsatzes, verfasst von Prof. Dr. Dr. h.c. Dirk Dubbers, Prof. Dr. Johanna Stachel (ehemalige Vorsitzende der deutschen physikalischen Gesellschaft) und Prof. Dr. Ulrich Uwer, war bemerkenswert. Es begann im ersten Drittel mit einer Eloge auf die Energiewende, welche an die von jeglicher technischen Sachkenntnis befreiten Aussagen einer Frau Claudia Kemfert erinnerte. Danach wendeten sich plötzlich Ton und Sachinhalt in der Schrift, sie wurde knallhart, sachlich und schonungslos. Ihr Schlussteil war dann wieder im gleichen Stil wie das erste Drittel gehalten.

Dieser alte Beitrag ist nun von den gleichen drei Autoren durch eine aktuelle und mutigere Version vom 15.7.2019 ersetzt worden und heißt jetzt „Energiewende: Fakten, Missverständnisse, Lösungen – ein Kommentar aus der Physik„, nachfolgend aufrufbar in Energiewende_Web_2019. Die alte Version ist im Netz nicht mehr vorhanden (vielleicht noch in Netzarchiven).

Erheiternd …

Erheiternd ist, die Klimaleugnerschmiede EIKE erwähnt nicht mal mit einem Wort, dass man in Heidelberg den anthropogenen Klimawandel nicht leugnet, sondern anerkennt.

Zurück zu den drei Professoren. Sie arbeiten bereits seit 2017 an einer ähnlichen Schrift. Und tatsächlich ist sie im Netz noch zu finden. Auch diesmal haben wir ein PDF gefunden.

In dem neuen PDF erklären die Professoren weiter …

Zwar ist der CO2-Ausstoß in den Jahren nach der Wiedervereinigung leicht zurückgegangen (um 25%), weshalb 1990 gern als Referenzdatum genommen wird. Dieser Rückgang lag jedoch vor allem an der Deindustrialisierung der neuen Bundesländer. Die in der Abbildung sichtbare geringfügige Abnahme im Jahr 2018, ausgelöst durch den vorangegangenen milden Winter, wurde in den Medien gebührend gefeiert.

Um zu verstehen, warum sich der CO2-Ausstoß trotz großer Anstrengungen nicht verringert, ist es wichtig, die Entwicklung der gesamten Energieversorgung zu betrachten. Es verzerrt das Bild, wenn man, wie es sich eingebürgert hat, nur den Stromsektor betrachtet, da dieser nur 18% des gesamten Energiesektors ausmacht. Außerdem sind große Verschiebungen zwischen den einzelnen Sektoren vorgesehen, und wenn man beurteilen will, ob eine solche Verschiebung möglich ist (etwa beim Wechsel vom Benzin- zum Elektroauto), muss man das Gesamtsystem betrachten.

Ok, dann betrachten wir den Wechsel vom Benzin- zum Elektroauto

Dazu lesen wir auf Seite 5 eine Einschätzung welcher Energiebedarf beim E-Auto, abgeleitet vom Verbrenner, angesetzt werden müsste…

Um ein Gefühl für die Größe dieser Zahlen zu bekommen: Die Leistung eines neu zugelassenen PKW liegt heute laut Kraftfahrt-Bundesamt im Mittel bei 111 kW. Bei typisch 30% Wirkungsgrad benötigt ein PKW unter Volllast daher 111 kW/30% = 370 kW Eingangsleistung. Natürlich ist nicht jeder PKW ständig mit Höchstgeschwindigkeit unterwegs, sondern im Mittel teilen sich dreihundert Elektroautos ein Windrad (die Autos in der Garage mitgezählt).

Aber angesichts eines Bestands von heute 46 Millionen PKW würden hierfür weit mehr als hunderttausend weitere Windräder gebraucht. Der grüne Strom kann aber nur einmal genutzt werden, und muss bereits für den Ersatz der Kernkraft herhalten. Elektroautos werden daher ihren Strom auch auf lange Sicht im Wesentlichen ganz aus konventionellen fossilen Kraftwerken beziehen. (Der oft zitierte, etwa dreifache Effizienzgewinn des Elektromotors gegenüber dem Benzinmotor geht durch die geringen 30%-Effizienz der fossilen Stromerzeugung wieder verloren.)

Elektroautos, so attraktiv sie sein mögen, tragen daher praktisch nichts zur Energiewende bei.

Was ist die Fragestellung?

Die Frage ist, wie viel Mehrbedarf an Strom braucht es für eine komplette Umstellung auf E-Mobilität. Nun kann man nicht erwarten, dass jedem sofort klar ist, dass Strommengen in Kilowattstunden kWh ausgedrückt werden. Wer auf die eigene Stromrechnung schaut, findet dort immer kWh. Kilowattstunden sind also eine Leistung, die man über eine Zeit bezieht.

Unsere Professoren, die doch selbst Physikfachleute sind, verwenden aber Kilowatt kW, also nicht die Energiemenge, sondern die Leistung, um das Problem zu beschreiben, und kommen dann zu der Feststellung, “Elektroautos, so attraktiv sie sein mögen, tragen daher praktisch nichts zur Energiewende bei.”.

Leistung, also kW, wäre für das Laden entscheidend, nicht aber für die grundsätzliche Frage wie viel Energie bereitgestellt werden muss, um den ganzen KFZ-Verkehr auf E-Mobilität umzustellen. Für diejenigen, die sich damit noch nicht beschäftigt haben gibt es den Artikel “Elektroauto – Die Zahl des Tages – 7,2 %”, in dem für jeden sehr einfach und nachvollziehbar vorgerechnet wird, dass wir tatsächlich sehr wenig Energie für diesen Teil des Verkehrs benötigen werden. Für alle PKWs in Deutschland sind es unter 10% der Strommenge an Mehrbedarf, die wir jetzt an Strom in Deutschland verbrauchen, wo wir noch am Anfang mit den eAutos stehen.

Auch das Laden der E-Autos ist nicht das Problem, denn wenn >90% aller Fahrten mit dem PKW unter einer Stunde am Tag sind, dann stehen 23 Stunden für das Laden zur Verfügung. Schnellladen, wo man innerhalb einer halben Stunde den Akku voll bekommt, wird nicht die Regel, sondern eher die Ausnahme für die meisten PKW sein.

Der nächste schwerwiegende Fehler

In der sehr kurzen Ausarbeitung der Heidelberger Physikprofessoren findet sich folgende Aussage:

“Zur Sonnenenergie: Eine Photovoltaikanlage kann bei senkrechtem Lichteinfall zur Mittagszeit im Hochsommer eine Leistung von 120 bis 140 Watt je Quadratmeter erreichen, über das Jahr gemittelt sind es in Deutschland aber nur 15 bis 20 Watt/m2.

Das ist so hanebüchen, dass man hier klar sagen muss, hier soll uns bewusst die Unwahrheit erzählt werden. Heutige PV-Anlagen haben im Mittel in Deutschland einen Ertrag von 1.000 Kilowattstunden im Jahr pro Kilowatt(peak). Kilowatt(peak) oder Watt(peak) ist die Angabe über die Spitzenleistung. Das Ergebnis aus dieser Leistung ist die geerntete Strommenge übers Jahr in Kilowattstunden (kWh). Das hängt aber vom Standort der Anlage und deren Ausrichtung ab. In Deutschland schwankt das bei südlicher Ausrichtung der Module je nach Standort heutzutage mit der aktuellen Modultechnik zwischen 900 kWh und 1.100 kWh pro Kilowatt(peak). Ein Kilowatt sind 1.000 Watt.

Nun brauchen wir noch die Angabe was das für den Quadratmeter Modulfläche bedeutet. Heutige Spitzenmodule haben eine Leistung von 360 bis 400 Watt. Die Größe ist bei den Herstellern weitgehend einheitlich aufgrund der Zellengröße und liegt bei ca. 1,6 m². Drei Module der 400-Watt-Klasse würden also 1,2 kW(peak) ergeben. Aufgrund der hohen Preise hat sich aber das 300-Watt-Modul zum Standard entwickelt, (Anmerkung 27.12.2020: Das wurde aber inzwischen schon durch das 340 bis 350 Watt-Modul abgelöst). Mit 400-Watt-Modulen hätten wir bei 3 Modulen eine Größe von 4,8 m² und eine Leistung von 1,2 kWpeak. Das bringt im Schnitt ein Jahresergebnis von 1.200 erzeugten Kilowattstunden. Das ist von Standort zu Standort verschieden, ergibt sich aber aus Erfahrungswerten für Deutschland im Schnitt.

Umgerechnet auf den Quadratmeter Modulfläche sind das 1.200 kWh / 4,8 m² = 250 kWh/m² und Jahr.

Völlig unsinnig ist aber eine Berechnung, in der man die Laufleistung einer solchen Anlage durch die Anzahl der Jahresstunden teilt, also auch durch die Nachtstunden in denen kein Watt zusammen kommt. So kann man hinterher behaupten, es wären nur 15 bis 20 Watt/m². Den gleichen Kniff wendet man auch bei den Windrädern an, nach dem Motto, Erneuerbare müssten zu jeder Zeit liefern können. Um auch dann hinterher festzustellen, das tun sie aber gar nicht. Das ist Kinderkram und dient der Sache nicht. Dazu folgender Artikel.

Wie kann solch ein enormer Fehler entstehen? Immerhin sind es 3 Professoren die hierfür verantwortlich zeichnen.

Um meine Behauptungen zu belegen,

Um meine Behauptungen zu belegen,

hier ein Datenblatt eines x-beliebigen 300 Wp Moduls. Zusätzlich verlinke ich noch ein Modul mit 400 Wp.

Mit immer besser werdenden Solarzellen hat sich der jährliche Ertrag immer weiter gesteigert. Hatten wir in den 90er Jahren einen Durchschnittsertrag von > 500 kWh pro kWp, was auch auf wenig Erfahrungen und oftmals verschatteten Dächer oder schlechte Dachausrichtungen zurückzuführen war. Bei guten Anlagen betrug der eher 700 kWh pro Jahr. Aber der Ertrag verbesserte sich mit der Zeit immer mehr.

Das hatte mehrere Gründe. Einer war mit Sicherheit, dass Zellen zwei Sachen immer besser konnten. Sie konnten mehr Schwachlicht ausnutzen und sie waren immer weniger von der Temperatur abhängig. Hohe Temperaturen senken die Leistung von Solarmodulen bekanntlich. So stieg die Leistung dann auf 800, dann 900 und heute auf 1.000 kWh pro kWp.

Anbieter werden jedoch immer einen etwas geringeren Ertrag angeben, weil sich Kunden dann über einen Mehrertrag freuen und nicht gleich beim ersten Unterschreiten mit dem Reklamationsrecht kommen.

Was bewegt also unsere Professoren dazu diese Desinformation ins Land zu schicken? Offensichtlicher geht es doch kaum mehr? Liest man genau, dann erschließt sich in einem Nebensatz anscheinend deren Stoßrichtung…

Zukünftige Energieversorgung

– In Deutschland selbst gibt es starke Schwankungen in der alternativen und vor allem in der solaren Energieversorgung, selbst wenn diese durch internationale Vernetzung etwas ausgemittelt werden können. Aber das weltweite Potenzial der Sonnenenergie ist sehr groß und sollte besser genutzt werden. In den äquatornahen Wüsten der Erde stehen große Flächen für den Einsatz von Solarkraftwerken zur Verfügung, und auch für die Windenergie gibt es deutlich günstigere Standorte als das relativ windstille deutsche Binnenland.

– Die Gefahren der Kernkraft (Kernspaltung oder Kernfusion) sollten im Vergleich zu den Gefahren des Klimawandels bewertet werden. Die in verschiedenen Industrienationen entwickelten Brutreaktoren erzeugen übrigens nicht nur CO2-freien, sondern auch erneuerbaren Strom.

Es geht also in Wahrheit darum der Kernenergie eine weitere Chance zu eröffnen. Wenn man das aber so dumm anstellt, dann fragt sich ob es tatsächlich so vorteilhaft ist die eigene Reputation und die der eigenen Fakultät damit aufs Spiel zu setzen.

Ein weiterer Lapsus

In dem Papier finden wir diese Grafik, die folgendermaßen untermauert wird und dies belegen soll…

Abbildung 2 zeigt den Anteil der verschiedenen Energieträger an der Energieversorgung, ebenfalls für die letzten zehn Jahre. Die oberen vier breiten Streifen der Abbildung zeigen die fossilen Brennstoffe Kohle, Erdöl und Erdgas. Sie tragen den Großteil der Energieversorgung und sind die wesentliche Quelle des CO2-Ausstoßes.

Die unteren fünf schmalen Streifen in Abbildung 2 zeigen die nicht-fossilen Energieträger, von Kernkraft bis Sonnenkraft, deren Betrieb die CO2-Bilanz nicht belastet. Der Anteil dieser nichtfossilen Energieträger an der Gesamtenergie des betreffenden Jahres (20%) hat sich seither praktisch nicht verändert, obwohl sich Deutschland im Klimapakt bis 2030 auf einen Anstieg dieses Anteils auf mindestens 30% verpflichtet hat (neben dem oben genannten 40% CO2-Rückgang). Absolut ist diese CO2-freie Energie seit 2009 sogar leicht zurückgegangen (um 1%).

Die nicht-fossilen Energieträger im Einzelnen: Die Kernenergie, 2018 bei 6,5%, soll bis 2022 auf null zurückgefahren werden, was die CO2-Bilanz weiter belasten wird. Die Wasserkraft, im Diagramm kaum sichtbar, ist mit 0,5% seit Jahrzehnten unverändert und hierzulande kaum noch auszubauen. Die Biomasse (Holz, Klärgas, Biodiesel u.a.) hat mit 9% Anteil in letzter Zeit wieder leicht abgenommen. Die Windkraft, am unteren Rand der Abbildung, trägt 3% bei, Photovoltaik und Naturwärme 2% (1,3% plus 0,7%). Zur Naturwärme gehören Wärmepumpen, Solar– und Geothermie.

Die in Abbildung 2 gezeigte bereitgestellte Energie wird genutzt als Wärmeenergie für Heizung/Kühlung und Warmwasser (2018 zu 32%) und als Prozesswärme in der Industrie (24%). Ein großer Teil fließt zur Bereitstellung mechanischer Energie in den Straßenverkehr (38%). Die restlichen 5% gehen zu etwa gleichen Teilen in Beleuchtung und Datenverkehr.

Was wird hier verschwiegen?

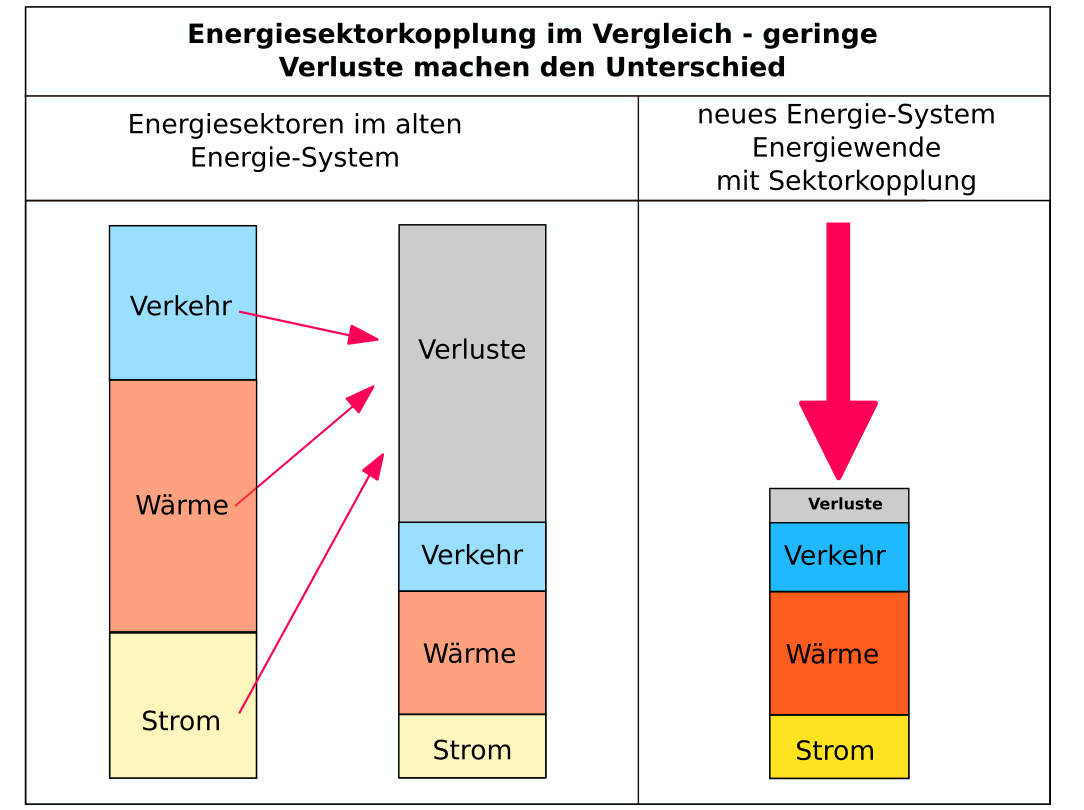

Eigentlich muss man sagen, das ist ein altbekannter Trick aus den Reihen der Energiewendegegner. Hier werden alle Energieformen gegenübergestellt, so wie sie zu einem bestimmten Zeitpunkt vorkommen. Aber das ist eine Darstellung, die etwas Essenzielles unterschlägt. Wir haben darüber schon im Artikel “Der kleine Trick mit der Primärenergie” berichtet. Wenn es mehr erneuerbaren Strom im Netz gibt und im Gegenzug Kraftwerke ausgeschaltet oder runtergeregelt werden, dann kommen auch deren schlechte Wirkungsgrade nicht mehr zum Tragen. Das bedeutet, die Grafik täuscht vor, dass der Anteil an Energie die ersetzt werden muss, der der jetzt eingesetzten Primärenergie ist. In Wahrheit benötigen wir aber viel weniger Energie, wenn wir erneuerbare Energien einsetzen, denn man muss nicht die riesigen Verluste der Kraftwerke ersetzen. Sie fallen einfach weg, wie diese Grafik zeigt:

Hier wurde also auch wieder rumgetrickst? Für wen bitte?

Sonnige Grüße

Euer Klaus Müller

Update 27.12.2020

Ich verlinke Euch das Filmchen mal hier, er ist nur knapp 4 Min lang. Aber das Filmchen hat es in sich, es ist ungeheuer professionell gemacht. Auch dazu wird es im neuen Artikel einiges geben.

Antwort nur zum kleinen Ausschnitt „Was wird hier verschwiegen?“

sie kommt ein wenig spät, ich hoffe sie wird noch gelesen.

Der Text des Ausschnitts:

Eigentlich muss man sagen, das ist ein altbekannter Trick aus den Reihen der Energiewendegegner. Hier werden alle Energieformen gegenübergestellt, so wie sie zu einem bestimmten Zeitpunkt vorkommen. Aber das ist eine Darstellung, die etwas Essenzielles unterschlägt. Wir haben darüber schon im Artikel “Der kleine Trick mit der Primärenergie” berichtet. Wenn es mehr erneuerbaren Strom im Netz gibt und im Gegenzug Kraftwerke ausgeschaltet oder runtergeregelt werden, dann kommen auch deren schlechte Wirkungsgrade nicht mehr zum Tragen. Das bedeutet, die Grafik täuscht vor, dass der Anteil an Energie die ersetzt werden muss, der der jetzt eingesetzten Primärenergie ist. In Wahrheit benötigen wir aber viel weniger Energie, wenn wir erneuerbare Energien einsetzen, denn man muss nicht die riesigen Verluste der Kraftwerke ersetzen. Sie fallen einfach weg, wie diese Grafik zeigt:

Meine -Antwort:

Zuerst muss die Physik die besagt “Einspeisung und Entnahme müssen sich die Waage halten befolgt werden” von den konventionellen Kraftwerken können das nur die Gaskraftwerke in Sekundenschnelle rauf und runter fahren. Kohlekraftwerke und Atomkraftwerke brauchen viel zu lange zum Rauf- und Runterfahren deshalb lässt man diese Kraftwerke auch durchlaufen und zwar als Primärleistung, d.h. zu dem und dem Zeitpunkt ist die Benötigte Energie man spricht dann von gesicherter Leistung in der Leitung abrufbar das ist für die Industrie sehr wichtig, Wind- und PV Strom landet durch dieses derzeitige Marktsystem auf den sogenannten Spotmarkt ist also keine Primärenergie die in der Sekunde wo sie benötigt wird sicher zur Verfügung steht. Dieser fluktuierend eingespeiste Strom steht nun als Überschuss zu einem sehr niedrigen Preis für Europa zur Verfügung, wenn ein Land diesen geschenkten Strom dann brauchen kann, steckt es hohe Gewinne ein. Aber auch die Länder stecken hohe Gewinne ein, die Strom liefern also Reserveenergie, wenn weder Wind weht noch Sonne scheint. Deutschland kann den verschenkten Strom, wenn kein Wind weht und keine Sonne scheint als Reserveenergie wieder teuer zurückkaufen. So lässt sich in den Ländern die ihre Leitungen frei geben können für die Aufnahme des kostenlosen Stroms aus Deutschland ihr Strompreis senken. Das passiert z.B. bei den Österreichern mit ihren Pumpspeichern so. Für Überschuss wird auf dem derzeitigen Markt nichts bezahlt im Gegenteil für die Abnahme wird je nach Situation sogar gezahlt, nur dass das Gleichgewicht bei Einspeisung und Abnahme im Netz vorhanden ist, diese Abhängigkeit ist auch die Ursache von Redispatchmaßnahmen, also wenn z.B. Windräder abgeschaltet werden. Jeder hat darüber den Kopf geschüttelt, niemand hat aber nach den Zusammenhängen gefragt. Denn es ist eigentlich der Kohlestrom der nicht abgeregelt werden kann, wenn der fluktuierende Strom zur Verfügung steht denn im Stromnetz ist Bedingung, dass die vorgegebene Frequenz gehalten wird.

Funktionieren würde aber ein Kombikraftwerk und zwar hätte da ein Gaskraftwerkbesitzer seine Stromerzeugung erweitern müssen indem er vielleicht 200 Windräder und 500 PV-Anlagen in einer Region gepachtet hätte. Da Gaskraftwerke regeln also sehr schnell heruntergefahren werden können, sobald Wind weht und Sonne scheint, hätte er Geld gespart, wenn er statt teuren Gases den fluktuierenden Strom eingesetzt hätte. Am Strommarkt kamen nämlich die Gaskraftwerke durch das Merit Order Prinzip kaum zum Einspeisen sie wurden von der sehr billigen Kohle verdrängt und so unwirtschaftlich. In diesem Zusammenhang war auch geplant Irsching das modernste Gaskraftwerk Europas abzuschalten, es sollte dann ein Reservekraftwerk vor Ort von Uniper gebaut werden. Warum dieser Unfug fragt man sich da doch? Aber ein Reservekraftwerk unterliegt nicht dem Merit Order Prinzip es ist ein Lieferant, wenn das Gleichgewicht im Netz fehlt also im schlimmsten Fall einen Blackout verhindern muss. Für die Stromlieferung dieses Kraftwerks wird darum jeder Preis gezahlt nur damit die Frequenz die kaum eine Toleranz verträgt stabilisiert wird. Noch ist dieses Regelkraftwerk nicht gebaut und so war zu lesen, dass die Bundesnetzagentur den Besitzer von Irsching bettelte, dass er sein Kraftwerk noch ein wenig weiterlaufen lässt. Zurück zu meinem Vorschlag Kombikraftwerk dieses Kombikraftwerk könnte Primärenergie liefern es wäre ein sehr stabiler Lieferant durch diese Planung wären keine Reservekraftwerke mehr erforderlich und auch kein Abschalten (Abregeln) von Wind und PV-Strom nur das Gaskraftwerk würde regeln also runter- gefahren werden, wenn zu viel Strom in die Leitung drückt. Dieser Strom wäre gesicherte Leistung und damit Primärenergie, sie würde die sichere Stromlieferung der Industrie garantieren. Aber die verkorkste Planung mit Ziel, Atomstrom für ganz Europa, hat alles kaputt gemacht, so ein Beispiel wurde überhaupt nicht untersucht, denn im Fokus stand die Erweiterung des europäischen Binnenmarktes und ein gemeinsames Stromnetz. Europa sollte von den deutschen Erneuerbaren am Spotmarkt und der Lieferung von Atomstrom profitieren. So sagte Merkel in ihrer Rede bei der Haushaltsdebatte 2020: „Strom für ganz Europa und Wohlstand für ganz Europa.“ Europa will als gesicherte Leistung keine fluktuierend einspeisenden Erneuerbaren, sondern Atomenergie also einen Lieferanten der zum Großteil auch CO2 frei ist. Das wiederum ist der Grund, warum so viele Atomkraftwerke in Europa geplant sind, hauptsächlich auch im Osten Europas diese Planungen existieren nicht erst seit heute, sondern schon seit vielen Jahren wie z.B. in Polen 6 Atomkraftwerke, in Tschechien 2, Ungarn, Rumänien Bulgarien, Slowenien denke ich sind es je Land ein Kernkraftwerk das zu bauen geplant ist. Zum europäischen Stromverbund gehört auch die Türkei da sind gleich 4 Atomkraftwerke geplant, und jetzt mit der Ukraine als neues Mitglied im Stromverbund wo sie jetzt schon das größte Kernkraftwerk Europas hat wird das europäische Netz mit Atomstrom überflutet werden. Wenn da eine Regierung nicht zum Volk hält werden unsere Bemühungen umsonst gewesen sein. Nun sind die Grünen an der Regierung, sie haben den Atomausstieg gefordert aber die Zusammenhänge mit der Versorgung auch gewusst, alles was da europäisch geplant ist, das Machtstreben und der Atomausstieg hat ihnen geholfen das Ziel an der Spitze der Regierung zu erreichen. Um also aus der Atomerzeugung und aus der Kohleversorgung auszusteigen und dann die Versorgungspläne Deutschlands mit Atomstrom aus den Nachbarländern umzusetzen ist es notwendig Deutschland mit einem riesigen Höchstspannungsnetz zu überziehen, diese Monstertrassen liefern dann den Atomstrom ungehindert wieder nach Deutschland ohne gesetzliches Verbot, auf die menschliche Gesundheit der Anwohner durch dieser Trassen wird keine Rücksicht genommen, da wird auch kein Halt gemacht bei den mühevoll geschaffenen Natura 2000 Gebieten, so viele Tiere sind da betroffen, die auf der Aussterbeliste stehen. Wegen den breiten Schneisen für die Trassen aber auch für die im Boden verlegten Gleichstromleitungen ist die Rodung von mehreren Quadratkilometern erforderlich also ein riesiger CO2 Speicher geht verloren, sollten irgendwo in Deutschland dann Ersatzbäume gepflanzt werden dann ergeben diese erst den gleichen Speicher vielleicht in 100 Jahren, denn so alt ist durchschnittlich der Wald der gerodet werden muss. Wo gerodet wird steigt der Nitratgehalt im Grundwasser damit haben viele Gemeinden schon heute Probleme, was machen sie dann? Ein weiteres Problem, wenn ein zusammenhängender Wald durch eine solche breite Schleise aufgeschlitzt wird. Dann stehen die dünneren Bäume außen ohne Schutzmantel schon ein kleinerer Sturm kann dann künftig einen sehr größeren Schaden anrichten viel größer als bei einem geschlossenen Wald. Auch der Borkenkäfer der bei der Wärme, wenn die Sonne da tüchtig auf den ungeschützten neuen Waldsaum scheint kann sich, durch eine solche riesige Schneise noch viel mehr ausbreiten.

Bei den Netzentwicklungsplänen der Bundesnetzagentur konnten die Bürger sich ja wehren, nur wenige von den 83 Millionen Bürgern haben die Möglichkeit wahrgenommen. Es geht aber um eine Vortäuschung dieses Atomausstiegs der nur dazu diente, dass die Grünen sich an die Macht beförderten.

Der Kommentar ist zu lange um auf alles einzugehen. Der grösste Unsinn der aber ins Auge sticht ist die Wirkungsgradberechnung des E-Autos. Du nimmst also tatsächlich die bewegte Luft als Ausgangswert? (Wirkungsgrad Windrad)

Dann musst du beim Erdöl/Gas aber auch den richtigen Wirkungsgrad nehmen. Nämlich die ganzen kWh an Sonnenenergie die notwendig waren um die Bäume wachsen zu lassen die dann nach x Millionen Jahren 1kWh Erdöl ergaben. Da bin ich auf das Resultat gespannt wie gross der Wirkungsgrad dann für ein Dieselfahrzeug ausschaut.

Vielen Dank Wolfgang Jenne, und das ist nur ein Beispiel.

Energiewende greift zu kurz!

Zufällig bin ich auf Ihre Webseite geraten. Ich habe mir Ihre Beiträge angesehen. Ebenso den Beitrag zum Thema „Grundlast“. Ihr Kollege meint der „Trick“ der Energieanbieter betreffend Grundlast bestehe darin, dass die Grafik doch nur eine Momentaufnahme sei, und in Wirklichkeit die Grundlast „knickbar“ ist. Ja, es müsse im Gegenteil gar nicht so viel Strom zur Verfügung stehen. Nun die Grundlast ist nichts anderes als der Strombedarf der IMMER bereitzustellen ist. JEDER Strom„erzeuger“ muss eine Leistungsreserve bereitstellen und zwar rund um die Uhr. Wie groß diese Leistungsreserve im Bedarfsfall ist, hängt von der Empirie ab. Und diese Mindestreserve ist die „Grundlast“. Es spielt also keine Rolle, welche Energiewandlungstechnik zum Einsatz kommt – die Grundlast macht alle gleich! Das ist auch leicht zu verstehen: Wenn Sie abends zu Bett gehen, drehen Sie die Lichter ab. Dann läuft außer Standby-Geräten, Kühlschrank in der Regel kein Stromverbraucher mehr. Vielleicht schalten Sie noch den Geschirrspüler ein, oder lassen auch gelegentlich die Waschmaschine dazu laufen. Doch angenommen, es gibt einen Anlass, dass Sie in der Nacht aufstehen und alle Lichter andrehen, den Fernseher einschalten, das Radio dazu, den Computer hochfahren. Dann muss dieser Strom IMMER da sein. Vielleicht tun es Ihre Nachbarn des Anlasses wegen Ihnen gleich, dann schnellt der Strombedarf in wenigen Augenblicken hoch, und diese Leistung muss daher jederzeit vom Strom„erzeuger“ bereitgestellt werden. Das ist die zu erwartende Grundlast. Auch kommt noch die Spitzenlast hinzu, die muss ebenfalls im Bedarfsfall abgedeckt werden. Nur durch Kraftwerke, die in der Lage sind rund um die Uhr diese Leistung bedarfsgerecht zu stellen, kann die Stromversorgung aufrechterhalten werden. Und diese Fähigkeit haben weder Windräder, noch Photovoltaikanlagen ohne die Möglichkeit des DIREKTEN Stromspeichers. Die sogenannte Konversionsspeicherung ist auf Grund der Wirkungsgradverluste, des technischen Aufwands und der Kosten keine Alternative. Es war schon vor längstens 15 Jahren absehbar, dass es völlig neuartiger Speichertechnologien bedarf, die erstens nicht auf dem bekannten chemisch-physikalischen Wirkprinzip beruhen und zweitens einen Speicherfaktor um 10.000 größer als jener von herkömmlichen Batterien aufweisen müssen. Nur haben die Windparkbetreiber leider auf Teufel komm´ raus lieber neue Spargel en massé in die Landschaft bzw. See gestellt, als sich zusammenzutun und solche neuartigen Speicher zu entwickeln, ebenso ein wirtschaftlicher Fehler, denn mit neuen Technologien und Patenten lässt sich ein Vermögen verdienen. Die gegenwärtigen Ambitionen in Wissenschaft und Technik kommen dagegen unwiderruflich zu spät – jetzt wären die postulierten Speicher vonnöten. Ohne völlig andere, neuartige Technologien jedoch gibt es keine „Energiewende“. Im Detail dazu:

1. Noch einmal zur Grundlast. Es erhellt sich zudem nicht, wieso der zeitliche Skalierungsmaßstab betreffend die Grundlast Bedeutung haben soll. Sie können jede Form der zeitlichen Skalierung wählen: alle 15 Minuten, jede Stunde, jeden Tag, die ganze Woche, Monate, Jahre. Die Skalierung ist doch bloß eine reine Darstellungsform zur Information und ändert an der Realität des Strombedarfs und seiner Grundlast überhaupt nichts! Was soll nun der „Trick“ dabei sein? Weiters muß bedacht werden, dass es physikalische Notwendigkeiten der Elektrotechnik gibt, dass Strom im Hintergrund im Kraftwerk permanent produziert wird. Zu nennen sind hier die Netzspannung, die konstant gehalten werden muss, sowie die Bereitstellung der Blindleistung.

Es ist somit einleuchtend, dass es die Verbraucherlast und die technischen Erfordernisse des Stromnetzes sind, die den Strombedarf fordern und nicht umgekehrt. Es hat sich also der Strom„erzeuger“ an den Verbrauch und die technischen Erfordernisse anzupassen und nicht vice versa. Weiters wird die Systemkomplexität (nicht „kompliziert“) unterschätzt. Man kann ein Energiesystem nicht beliebig dezentralisieren, weder verbraucherseitig, noch durch technische Erweiterungen wie Umrichter etc., weil mit jeder weiteren Dezentralisierung der Komplexitätsgrad zunimmt. Wird der kritische Punkt der Komplexität überschritten, dann wird das System unbeherrschbar und instabil, was letztlich früher oder später zu Dauerausfällen führt. Ein Maß für die kritische Komplexität ist die Zahl der außergewöhnlichen Regeleingriffe. Beschränkten sich diese noch vor zehn Jahren in Österreich und Deutschland auf eine Handvoll Tage im Jahr, so sind sie bis 2019 regelrecht explodiert. Außerplanmäßige Regeleingriffe erfolgen nur, um das Stromnetz stabil zu halten und einen Netzzusammenbruch zu verhindern. Der Fachterminus ist „Redispatch“. Und diese Regeleingriffe sind zudem sauteuer. Betrugen die Kosten für Redispatch-Maßnahmen in Österreich 2015 rund 23 Mio. Euro, so vervielfachten sie sich bis 2019 auf rund 152 Mio. Euro, bezahlt vom Konsumenten. Ursache dafür ist die kritische Zunahme von Volatilstrom hauptsächlich aus Windkraftanlagen. Dieser Volatilstrom hat nunmehr eine systemkritische Grenze überschritten.

Dass Volatilstrom zur Grundlastdeckung völlig ungeeignet ist, ist eine technische Tatsache. Dazu zwei Ereignisse: Im Jänner / Februar 2021 erließ die schwedische Regierung einen Aufruf an die Bevölkerung bis auf Weiteres nicht mehr staubzusaugen. Aufgrund der klirrenden Kälte waren alle Windräder eingefroren, und es herrschte zudem Windflaute. Dieser Aufruf wurde in der schwedischen Öffentlichkeit kritisch kommentiert, schließlich mussten die ungeliebten fossilen Kraftwerke wieder reaktiviert werden. Am 13.1. kam es im ENTSO-E-Netz zu einer Netzauftrennung: ein Strom-Blackout-Super-GAU drohte. Der Ausfall eines Netzverteilers in Kroatien bzw. Rumänien war dagegen bloß eine kaskadische Folgeerscheinung. Tatsächliche Ursache war die kritische Stromlage in Frankreich, sowie die Stromknappheit in Italien. Bereits vor dem „schwarzen“ Freitag den 13.1.war die Stromlage in Frankreich dermaßen kritisch, dass es zum Lastabwurf von Großverbrauchern kam. Was leisteten nun Windkraft und Photovoltaik an jenem 13.1. Punkt 13:00, also 5 Minuten vor Eintritt des kritischen Ereignisses, in Deutschland? Zu diesem Zeitpunkt bestand ein Lastbedarf von 66,26 GW im deutschen Stromnetz, der Beitrag der Windkraft zu diesem Lastbedarf um 13:00 betrug 4,34 GW, jener der Photovoltaik 2,12 GW, in Prozenten ausgedrückt betrugen die Anteile 6,5 und 3,2 % des Lastbedarfes. Aus der Sicht des Technikers ist es somit ganz klar, dass volatiler Strom ohne DIREKTE Speicherung für eine gesicherte Lastversorgung absolut ungeeignet ist. Weiters ist zu hinterfragen, ob es Sinn macht fossile Strom„erzeuger“ einfach gegen grüne zu „tauschen“. Solange die Energiehoheit nicht wirklich beim Bürger ist, er weiterhin von Systemstrom abhängig bleibt, gibt es kein echtes dezentrales System, im Gegenteil zahlt er für eine fragwürdige Förderung für eine noch fragwürdigere „Energiewende“ (was soll das überhaupt sein?) einen immer höheren Preis. Doch es gäbe Alternativen, dazu komme ich weiter unten.

2. Energieträger und Wirkungsgrade. In Ihrem gegenständlichen Artikel verweisen Sie auf weitere „Tricks“, wie die Grafik der Energieversorgung, und dass drei Professoren der Universität Heidelberg „unrichtige“ Angaben zur Durchschnittsleistung von Photovoltaikanlagen in D getätigt, womöglich damit ihren Ruf, sowie den ihrer Fakultät beschädigt hätten. Bei der Grafik zur Energieversorgung in D aus 2009 bemängeln Sie, dass auch die Verlustenergie miteinbezogen worden sei. Vermutlich wollen Sie damit sagen, dass, wenn man die „Verlustenergie“ herausrechnet, sich die dargestellten %-Anteile für die fossilen Energieträger Kohle und Erdöl verringern und jene für die „Erneuerbaren“ erhöhen und damit vorteilhafter darstellen ließen. Dabei bringen Sie auch noch die Wirkungsgrade ins Spiel und meinen, jene der fossilen Kraftwerke seien „so schlecht“, deren Verlustleistung so groß. Dies untermauern Sie noch mit der nachgestellten Grafik über eine „Energiesektorkopplung“ im „alten“ und „neuen“ System. Zunächst zum Sachverhalt betreffend die Energieversorgung in Deutschland. Hier ist es klar, dass die Größenordnung der Energie„erzeugung“ mit dem Energiebedarf korreliert ist. Im Jahr gibt es in Deutschland einen Gesamtbedarf an Wärme und Strom. Die verwendeten Energieträger dazu sind die fossilen Kohle, Erdöl, Erdgas und eben die „Erneuerbaren“. Deren Mengen in Gigatonnen bzw. Leistung in GW sind statistisch exakt bekannt. Setzt man den ebenso statistisch exakt bekannten Gesamtenergiebedarf in Deutschland mit 100 % an, so ergeben sich aus den ebenso statistisch exakt bekannten Beiträgen der einzelnen Energieträger deren Anteile in Prozenten. Jeder Anteil in Prozent besagt, wie viel jeder der Energieträger zur Gesamtversorgung beigetragen hat. Nicht mehr und nicht weniger. Wenn etwa ein GuD-Kraftwerk mit einer elektrischen Nennleistung von 520 MWel übers Jahr auf 4.000 Volllaststunden kommt, dann hat das Kraftwerk im Jahr 2.080.000 MWh = 2 TWh elektrische Energie vulgo Strom zum Gesamtenergiebedarf beigetragen. Nirgendwo ist da eine Verlustenergie enthalten und selbstverständlich ist der Gaspreis ein Marktpreis und enthält keinen kompensatorischen Preis für Verlustenergie. Zwar kennt der Markt unterschiedliche Gasqualitäten, auch bei Kohle, jedoch wird eine solche über den Heizwert definiert und nicht über die (hypothetische) Verlustleistung. Dem Gaspreis ist überhaupt die Nutzungsmodalität völlig egal. Ob Sie Gas verbrennen oder nur weiterverkaufen, auf Reserve lagern, ist für den Gaspreis irrelevant. Und auch der Konsument bezahlt nicht für die Verlustleistung, die er ja gar nicht konsumieren kann. Und genau gleich verhält es sich mit den Anteilen aller anderen Energieträger. Etwa bei der Windkraft. Wenn ein Windpark mit einer installierten elektrischen Gesamtleistung von 50 MWel im Jahr 2.000 Volllastunden leistet, liefert er 100.000 MWh = 0,1 TWh elektrische Energie zum Gesamtbedarf ab. Auch hier ist keine Verlustleistung bzw. Verlustenergie enthalten. Der Kunde bezahlt nie eine Verlustleistung. Kurzum: In jeder Verbrauchsgrafik ist die tatsächliche abgelieferte Energieleistung auf den Energiebedarf normiert. Ob darüber hinaus produzierte Strommengen auf dem Markt verkauft, exportiert werden, steht dagegen auf einem anderen Blatt.

Betreffend die Durchschnittsleistung der Photovoltaikleistung in D ist die von den Professoren genannte Größenordnung korrekt. Allerdings hätten diese der guten Ordnung halber die Randbedingungen für ihre Ergebnisse erwähnen sollen, das findet man in für die Öffentlichkeit bestimmten Expertisen immer wieder, dass die Randbedingungen für die dargestellten Werte, Ergebnisse nicht mit veröffentlicht werden. Das kann man kritisieren. Doch die Professoren nahmen es als selbstverständlich an, dass bei einem Vergleich aller Energiekonversionsanlagen die Jahresstunden mit 24 h Tageslänge als gleiche Bedingung berücksichtigt werden müssen. Sonst vergleicht man Äpfel mit Birnen. Ob dieser Selbstverständlichkeit haben sie nicht extra darauf hingewiesen, dass diese Annahme auch für die Photovoltaik zugrunde gelegt wird, sonst kann man sie nicht mit fossiler Kraftwerksleistung vergleichen, die rund um die Uhr erbracht wird. Daher stimmen diese Ergebnisse unter Berücksichtigung der angenommenen verfügbaren Leistung für Solarpanele. In Süddeutschland kann unter den Sonnenbedingungen mit 1 Wp → 1 kWh / a Strom erzeugt werden. Mit einer Kollektorfläche von 10 m2 kann sodann 1 MWh / a elektrische Energie erzeugt werden. Mit 40 m2 Kollektorfläche lässt sich damit der Strombedarf eines Einfamilienhauses decken. Randbedingung: 1 m2 Kollektorfläche leistet 100 Wp. Neue Panel-Materialien werden zukünftig die thermischen Verluste weitgehend reduzieren und deshalb wie überhaupt den Wirkungsgrad steigern. Allerdings bleibt der Umstand, dass bei Sonnenlichtschwächung und in der Nacht die Leistung der Photovoltaik gegen Null geht. Trotzdem hat Photovoltaik etliche Vorteile gegenüber Windparks, hier, weil die Stromgenerierung durch den Verbraucher selbst erfolgt und kein grüner Energiemogul ein Marktmonopol bzw. -oligopol ausübt. Die Energiehoheit liegt nun teilweise beim Konsumenten, weshalb hier eine partielle Dezentralisierung des Energiesystems vorliegt. Teilweise deshalb, da der Überschußstrom, sofern nicht gespeichert, ins Stromnetz eingespeist werden muss. Und die aktuell verfügbaren Batterien dazu sind teuer.

Betreffend die Wirkungsgrade im Zusammenhang mit der Verlustleistung bzw. Verlustenergie erhellt sich in der Grafik „Sektorkopplung“ nicht, wieso die Verluste im „alten“ System hoch, im „neuen“ System so niedrig ausfallen sollen. Für die Verlustenergie ausschlaggebend ist zuallererst der technische Wirkungsgrad der Energieumwandlung. Dieser ist Taktgeber und kann durch Kopplung nie wettgemacht werden. Ihre Aussage, dass fossile Kraftwerke einen schlechten Wirkungsgrad haben und dagegen die Wirkungsgrade der „Erneuerbaren“ besser sein sollen, findet keine Entsprechung gemäß dem aktuellen Stand der Technik. Von den fossilen Kraftwerken besitzen Kohlekraftwerke mit 45 % den schlechtesten Wirkungsgrad, dagegen sind GuD-Kraftwerke mit 61 % Wirkungsgrad unübertroffen und überlegen. Selbstverständlich sprechen wir hier von den elektrischen Wirkungsgraden! Bei den thermischen Wirkungsgraden können heute sogar Wirkungsgrade von über 80 % erzielt werden! Auch stimmt in der Grafik „Sektorkopplung“ der Vergleich von Strom, Wärme und Verkehr nicht. Der spritgebundene Verkehr bezieht seine Energie NICHT durch bereitgestellte Kraftwerksleistung und ist deswegen ein unabhängiger Sektor. Da werden Äpfel mit Birnen verglichen, weil sich Energiebereitstellung und Antriebstechnologie hier NICHT vergleichen lassen. Ein spritabhängiger Antrieb besteht aus dem Energie„erzeuger“, dem Motor und der Kraftübertragung, die Energieumwandlung der chemisch gebundenen Energie findet daher vor Ort direkt im Aggregat statt. Die im Sprit chemisch gebundene Energie verändert sich bis zur Verbrennung nicht, der Wirkungsgrad des Verbrennungsmotors ist thermisch und bezieht sich auf reale 100 % Energie des Kraftstoffes im Tank. Elektroautos haben keinen Energie„erzeuger“ an Bord und sind auf externe Kraftwerksleistung angewiesen. Der elektrische Wirkungsgrad beinhaltet die gesamte Wandlungskette vom Windrad, den Systempunkten wie Umformer, Gleichrichter etc. und die dabei auftretende Verlustenergie incl. Transport bis zur Ladestation. Dem Elektroauto steht also ein um diese Verlustenergie vermindertes Stromangebot an der Ladestation zur Verfügung. Die Batterie hat einen Wirkungsgrad von etwa 97 %, der E-Motor ab einer Leistung von 75 kW mehr als 93 %. Eine Modellrechnung zur Illustration: Der Wirkungsgrad eines Windrades am Übergabepunkt beträgt 34 %, die installierte elektrische Nennleistung entspricht bereits diesem Wirkungsgrad. Die zusätzlichen Systemverluste reduzieren den Wirkungsgrad auf 24 %, das ist der Systemwirkungsgrad an der Ladestation. Dazu 97 % Batteriewirkungsgrad und 93 % Wirkungsgrad des E-Motors ergeben 0,24 x 0,93 x 0,97 = 0,216504 = 21,7 %. Das ist die tatsächlich im E-Auto umgesetzte Exergie (= Strom). Das ist der elektrische Gesamtwirkungsgrad des E-Autos, der somit deutlich unter dem thermischen Wirkungsgrad des Spritautos liegt. Der thermische Wirkungsgrad ist eben wegen der An-Bord-Konversion mit 34 bis 40 % höher. Solange der Elektroantrieb von einer externen Stromquelle abhängt, wird sich daran nichts ändern. Zudem muss noch die Verlustenergie von rund 79 % durch zusätzliche Kraftwerke ausgeglichen werden, denn das E-Auto will seinen Strom haben, ohne Rücksicht auf Verlustenergie. Weitere systemische Nachteile entstehen durch das hohe Eigengewicht die Batterie und deren rascheren Erschöpfung unter Volllast, verbunden mit einer Verkürzung der Lebensdauer und einer deutlich kürzeren Reichweite. Seinen Vorteil kann der Elektromotor derzeit nur bei entsprechender Leistung im Falle einer entkoppelten Elektrotraktion ausspielen. Das ist nur bei der Eisenbahn der Fall. Für den privaten Verkehrssektor steht die direkte Energiekonversion (= im Auto) noch aus, ist aber möglich, darauf komme ich weiter unten bei den Alternativen zu sprechen.

Grundsätzlich sind fossile Kraftwerke hinsichtlich der Wirkungsgrade Windrädern und Solarpanelen weit überlegen. So liegt der theoretisch erreichbare Windwirkungsgrad eines Windrades aus physikalischen Gründen bei 59,9 %. Diese Grenze kann nie überschritten werden. Der tatsächliche Wirkungsgrad eines Windrades vom Wind bis zur Leistungsabgabe an das Netz beträgt 34 %. Die zukünftigen Windräder mit höherer Rotor- und Generatorleistung werden einen elektrischen Wirkungsgrad von 40 % erreichen, vielleicht auch noch auf 45 % steigerbar. 45 % ist das Niveau von Kohlekraftwerken (Verbrennung). Nicht anders sieht es bei Solarpanelen aus. Der kurzfristige technische Fortschritt lässt eine Steigerung des elektrischen Wirkungsgrades auf 40 % erwarten. Summa summarum ist die elektrische Verlustleistung des „neuen“ Systems bei „Sektorkopplung“ mit dem E-Verkehr höher als im „alten“ System, vor allem, wenn wir die Substitution aller Spritfahrzeuge im Verhältnis 1 : 1 annehmen. Auch die erwähnte Umstellung von 20 Mio. Kfz auf Strom relativiert sich. Wenn Sie schreiben, eine solche Umstellung würde lediglich rund 7 % mehr Strom gemessen am heutigen Strombedarf erfordern, so sollten Sie überlegen: in D gibt es meines Wissens mind. 50 Mio. und nicht 20 Mio. Kfz. Ob da auch die Nutzfahrzeuge enthalten sind, weiß ich nicht. Zum Vergleich gibt es in Österreich inklusive Nutzfahrzeuge aktuell 7,5 Mio. Kfz. Die alle auf Strom umzustellen würde unter realistischen Bedingungen noch zusätzliche 30 Donaukraftwerke erfordern. Wie wollen Sie dann bitte in D 50 Mio. Kfz auf „Erneuerbaren“-Strom umstellen? Wissen Sie wie hoch die erforderliche zusätzliche Kraftwerksleistung sein muss? Die prognostizierte durchschnittliche 1 h-Fahr- und 23 Stunden-Ladezeit ist unrealistisch, auch dann, wenn diese vom Fraunhofer-Institut behauptet wird. Solche unrealistischen Durchschnittswerte kommen immer durch statistische Relativierungen zustande. Das Stromnetz ist jedoch kein „Durchschnittsnetz“, der Strombedarf weist gebietsweise und zeitlich sehr große Unterschiede auf. Das wird dann mit dem statistischen Mittelwert niedergebügelt. Dasselbe Problem haben wir mit der globalen Durchschnittstemperatur. Die Varianzen sind derart groß, dass da nie ein vernünftiges statistisches Modell herauskommen kann. Ich bezweifle, dass solche Modelle über die Prüfung auf Varianzhomogenität hinauskommen. Das geht nur mit Trickserei und / oder „Einbügeln“ unerwünschter „Ausreißer“. Man kann natürlich die Modellannahmen so „anpassen“ bzw. „stimmen wie ein Klavier“, dass „Störer“ nicht wirksam werden. Der wissenschaftlichen Spitzfindigkeit sind da keine Grenzen gesetzt.

3. Energiewende ist Rohstoffwende. In dem Artikel zur Grundlast wird angemerkt, es gäbe ja auch noch Wasserkraft, Biogas und Biomasse. Nun ist die Wasserkraft vielleicht in Österreich eine Option – 60 % des Strombedarfs deckt hier die Wasserkraft. Doch die restlichen 40 % bringen auch die Ösis zum Schwitzen. Erst Recht gilt das für D. Es ist schier unmöglich die Wasserkraft zur Deckung der Grundlast weiter auszubauen. Bleiben also noch Biogas und Biomasse. Will man Strom gewinnen, müssen Biomasse (Holz) und Biomethan verbrannt werden, so das bisherige Credo der Energiwende-Apologeten. Und spätestens jetzt wird die „Energiewende“ unglaubwürdig. Während die Verbrennung von Kohle verteufelt wird, erhält die Verbrennung von Biogas und Holz einen Persilschein. Betreffend Biogas konnte mir bis dato niemand erklären, warum die Verbrennung von Methan aus Biogas gut, das Abfackeln von Methan dagegen schlecht sein soll. Und ganz speziell ist das mit der Biomasse. Während die Kohle, obwohl sie ein reines Pflanzenprodukt und betreffend Energiedichte und C-Gehalt ein Göttergeschenk ist, verteufelt wird, wird die Verbrennung von Holz sanktioniert. Ich höre dann als Argument, der im Baum enthaltene Kohlenstoff sei ja aus dem CO2 der Luft assimiliert worden, sodass ein geschlossener CO2-Kreislauf gegeben sei. Na denn!!! Das ist natürlich blanker Unsinn. Hier wird die Massenbilanz des Kohlenstoffes angesprochen, doch die ist natürlich immer „0“, soll heißen ausgeglichen. Und das ist ein gültiges Naturgesetz, das für alle Stoffe gilt. Auch in der Kohle kann nur der Kohlenstoff verbrannt werden, der bereits in der Kohle assimiliert vorliegt. Ich merke an dieser Stelle der Vollständigkeit halber an, dass Erdöl tierischen, Kohle rein pflanzlichen Ursprungs ist. Die Grundlage der Kohle bildeten die ersten Nacktsamer, die Farne, im Karbon. Es ist auch da bemerkenswert, dass im Karbon die Nacktsamer die Erde mit einer nie mehr erreichten Pflanzenvielfalt beglückt haben. Der Artenreichtum des Karbons wird durch die heute vorherrschenden Bedecktsamer (Blütenpflanzen) nicht erreicht – nur zum Nachdenken, wenn heute von Biodiversität die Rede ist und Laubbäume und deren Mischwälder gepflanzt werden sollen, das ist ja auch eine Forderung der Öko-Klima-Aktivisten. Ein Irrtum übrigens, wie die konventionelle Energiewende auch. Die Wahrheit ist, es gibt unter dem Postulat der CO2-Klima-Hypothese KEINE klimaneutrale Verbrennung. Der Chemiker kommt ob des Öko-Postulats von der klimaneutralen Verbrennung von biogenen Stoffen wie Holz nicht aus dem Staunen heraus. Von Bedeutung ist nämlich nicht die Massenbilanz, sondern der Phasenübergang von festem Kohlenstoff (C) in sein gasförmiges Pendant CO2 im Zeitintervall dt. „dt“ steht für ein infinitesimales Zeitintervall. Verbrennung ist unter dem Postulat der CO2-Klima-Hypothese nun genau deswegen NIE klimaneutral, weil das Zeitintervall dt der Verbrennung (= Dissimilation) immer sehr viel kleiner ist als das Zeitintervall dt der Assimilation. Ein Beispiel dazu:

Ein 80 Jahre alter Baum, 25 m hoch, liefert 4 t Brennholz. Dieses wird einer Heizanlage zugeführt, die jährlich 0,5 t Brennholz benötigt. Frage: In welchem Zeitintervall hat die Heizanlage das Brennholz „durch“? Die Rechnung ergibt 4 t / 0,5 t = 8 Jahre. Die Verbrennung setzt also den im Holz fest gebundenen Kohlenstoff (fester Aggregatzustand) in 1/10 der Assimilationszeit wieder als CO2 frei. Den Dissimilationsfaktor erhält man aus 8 J / 80 J = 1/10.

Doch nun fehlt auch der entnommene Baum als weitere Assimiliationsfunktion, weshalb der „Klima-Schaden“ doppelt so groß wird. Wollte man die entfallene Assimilationsleistung zeitgleich egalisieren, dann müssten etwa 1.000 Stecklinge gesetzt werden, da Stecklinge in den ersten Lebensjahren nur sehr wenig Photosynthese betreiben. Damit wäre im Jahr 1 der Baumentnahme wenigstens dieser Schaden ausgeglichen. Merke daher:

„Ob Holz, ob Fossil, ob Müll ist einerlei, in der Verbrennung liegt die Frevelei!“

Somit kann nun die Überleitung zu den Alternativen erfolgen. Es gibt sie tatsächlich, und sie lösen mit einem das Rohstoff- und Energieproblem unserer Zivilisation. Der springende Punkt ist, dass niemand in der Öko-Szene erkennt, dass nicht die Energiewende, sondern die Rohstoffwende das entscheidende Kriterium ist. So sind alle stofflichen Energieträger der Biosphäre zugleich Rohstoffträger, die Energie in chemisch gebundener Form enthalten. Das Erdöl beispielsweise besteht aus Kohlenwasserstoffen, den Grundsubstanzen der gesamten belebten Biossphäre. Durch die Verbrennung wird zwar die enthaltene chemisch gebundene Energie in Wärme konvertiert, aber die Kohlenwasserstoffe gehen dabei unwiederbringlich verloren. Das Oxidations-Endprodukt von C ist das stabile CO2, das chemisch gesehen ein besonderer „Stoff“ ist. So ist in den fundamentalen biochemischen Prozessen des Lebens CO2 ein wichtiger Reaktant. CO2 ist also keine Laune der Natur, sondern ein chemisch wohlbegründeter Stoff. Und auch in der Synthesechemie ist es heißbegehrt, denn CO2 ist das Intermediat für alle elementaren Synthesewege. Aufgrund seiner Stabilität ist es leider chemisch „inert“, weshalb Katalysatoren erforderlich sind, um es wieder reaktiv werden zu lassen. Die Natur aber, die Chemie des Lebens, hat dieses Problem mithilfe von Enzymen bereits vorzüglich gelöst. Der Königsweg ist nun ein anderer Weg der thermochemischen Konversion als die Verbrennung, nämlich die Vergasung. Der Unterschied zur Verbrennung ist die Teiloxidation des C-haltigen Inputmaterials unter Luftausschluss bis zum CO. Es handelt sich dabei eben nicht um die bekannte Holzvergasung, sondern um die allotherme Vergasung unter Wasserdampf- oder noch besser CO2-Atmosphäre. Letztlich entsteht aus jedem organischen C-haltigen Inputmaterial CO und H2, das sogenannte Synthesegas (Syngas). DAS braucht die Synthese-Chemie. Dieses Gemisch ist Gold wert, denn führt man es einem nachgeschalteten Fischer-Tropsch-Reaktor zu, dann erhält man ein Kohlenwasserstoffgemisch als Erdölsubstitut, und zusätzlich Prozesswärme als Abwärme für Heizzwecke und Stromgenerierung. Mit Syngas-Anlagen mit integriertem FT-Reaktor lassen sich Kohlenwasserstoffe, Wärme und Strom aus einer Hand generieren. Ich habe vor einem Jahr BM Altmaier in einem ausführlichen Brief vorgeschlagen, die Kohlekraftwerke von der Verbrennung auf Kohlevergasung mit nachgeschaltetem FT-Reaktor umrüsten zu lassen. Leider habe ich keine Antwort erhalten, stattdessen werden die Kohlekraftwerke geschlossen. Es ist weltweit dasselbe Problem. Anstatt, dass China täglich Dutzende Kohleverbrennungsanlagen in Betrieb nimmt, könnte es Syngas-Anlagen in Betrieb nehmen. Die installierte thermische Leistung der deutschen Kohlekraftwerke ist mehr als ausreichend, um sie wirtschaftlich als Syngas-Anlagen mit FT-Synthese weiter zu betreiben. Trotzdem geschieht……NICHTS! Ein weiterer Vorteil von Syngas-Anlagen ist, dass JEDES organische Inputmaterial verarbeitet werden kann, also auch Sondermüll, denn im Syngas wird alles gleich, alles zu CO und H2 konvertiert. Damit erhellt sich, dass Rohstoff- und Energiewende untrennbar einhergehen. Das wäre das „Perpetuum Mobile“ einer echten Kreislaufwirtschaft, wie sie mit Recyceln nie erreicht werden kann, diese ist im Gegenteil eine Sackgasse. Das völlige Unverständnis für die Materie zeigt die gegenwärtige Kunststoff- vulgo Plastikdebatte. In Wahrheit ist „Plastik“ das Schwarze Gold schlechthin. Im Gegenteil müsste man so viele Kunststoffabfälle wie nur möglich zu erheischen versuchen, diese dann via Syngas-Anlagen zu Kohlenwasserstoffen, Wärme, Strom konvertieren. Hat man so viel „Plastik“, um etwa den Kohlenwasserstoffbedarf der deutschen Volkswirtschaft zu decken, dann erschafft man eben dieses „Perpetuum Mobile“ der Kreislaufwirtschaft, ein de facto unendlicher Zyklus, weil rohstoffmäßig nichts verloren geht, abgesehen von den enthaltenen anorganischen Begleitstoffen. Wer es fassen kann, der fasse es!

Der Stromhunger des mikroelektronisch-digitalen Zeitalters wird noch ins Unermessliche steigen. Daher sind Windräder elektrotechnisch schon jetzt ein Anachronismus. Schon aber gibt es das Pendant zum rohstofflichen „Perpetuum Mobile“ auch für die Stromgenerierung. Das Energie-Perpetuum-Mobile heißt Neutrino-Voltaik. 2015 erhielten zwei Physiker für ihre bahnbrechende Entdeckung den Nobelpreis für Physik. Sie konnten beweisen, dass Neutrinos, die „Geisterteilchen“ der Physik, doch geringe Masse besitzen. Neutrinos entstehen bei bestimmten kosmischen Vorgängen im Universum. Sie sind unerschöpflich, durchdringen JEDE Materie, da sie auch ungeladen sind. Pro cm2 und sec. strömen 60 Mia. Neutrinos durch. Gelingt es nun ein genügend dichtes Material zu finden, sodass der Neutrinostrom nur wenig abgebremst wird und koppelt man dieses Material mit einem Ladungsträger wie Silizium, dann induziert das Strom. Forscher glauben ein solches Material gefunden zu haben: Graphen. Erste Versuche verliefen erfolgversprechend. Jetzt geht es um den Skalierungsfaktor. Das C für Graphen wird nach einer Methode des KIT aus dem CO2 der Luft extrahiert. Übrigens ein weiteres Argument für fossile Kraftwerke. Es lässt sich das gesamte CO2 aus dem Abgas extrahieren. Dazu gibt es gerade in D intensive Forschung. Während Kraftwerke nicht nur eine sichere Stromversorgung garantieren, liefern sie auch noch zusätzliche Wertschöpfung durch das CO2 und werden selbst CO2-frei.

Würde man das Geld, anstatt es für EEG und Ausbau von Windkraft und Photovoltaik zu verprassen, in die konventionelle Nutzbarmachung der Neutrino-Voltaik stecken, dann hätten wir binnen Kurzem eine wahrhaft dezentralisierte Energieversorgung ohne Ende. Solange das Universum steht, solange wird der Neutrinostrom ubiquitär vorhanden sein. Jeder Verbraucher (= elektrisches Gerät) erhält dann einen Neutrino-Strom-Konverter eingebaut. Batterien, Stromnetze, Kraftwerke, Windräder werden obsolet. Jeder Mensch hat dann so viel Strom wie er benötigt, immer und überall, völlig autark. Das nenne ich eine echte Energieautarkie. Neutrino-Voltaik und Syngas-Anlagen garantieren das sichere zukünftige Überleben unserer Zivilisation im jeweiligen wissenschaftlichen und technischen Status Quo.

Bleibt noch das dritte Problem der Wende zu lösen: die Substitution der anorganischen Rohstoffe. Doch auch hier leistet die Wissenschaft bereits Bahnbrechendes: Es ist möglich Atome künstlich so anzuordnen, dass völlige neuartige synthetische Stoffe entstehen, die in der Natur nicht vorkommen. Wissenschaft und Technik treiben die Lösung aller stofflichen und energetischen Ressourcenprobleme unserer Welt voran, Wissenschaft bricht Natur- und ökonomische Monopole!!! That´s it!

Mit freundlichen Grüßen

Rudolf Hammer

Wow, so ne Menge massiven Bullschit, sorry ich kann mich da nicht zurückhalten, hab ich lange nicht mehr gelesen.

Schönen Tag noch.

Es stimmt, dass die Grundlast in den Stromnetzen nie unterschritten werden darf. Sollte es doch passieren droht der black out.

Solarenergie mag sicherlich interessant sein aber jede Solarzelle muss mit einem anderen Kraftwerk abgesichert werden, wenn die Solarzelle keinen Strom liefert. Nachts und im Winterhalbjahr kommt da nicht mehr so viel.

Vielen Dank für Ihren Kommentar. Der gehört aber eher zu Geschichte der Energiewendekritik und agiert mit Begriffen wie Grundlast. Grundlast als Begriff ist eher Desinformation und passt gar nicht zu einem erneuerbaren Energiesystem.

Dazu mein Artikel, Grundlast kannst du knicken. https://energiewende-rocken.org/grundlast-kannst-du-knicken/

Aber auch andere haben dazu geschrieben und die Wissenschaft zur Energiewende lehnt den Begriff auch als irreführend ab. Sicher wird auch das mal im Geschichtsbuch der Energiewende stehen.

MfG Klaus Müller

Hallo Klaus,

mir ist gerade ein inhaltlicher, vermutlich Flüchtigkeits-, Fehler aufgefallen:

Zitat:

“Hatten wir in den 90er Jahren einen Durchschnittsertrag von > 500 kWh pro m²…”

Es muss hier “> 500 kWh pro kW(peak)” heißen, wenn ich mich nicht irre.

Vielen Dank für den guten Beitrag:

Mir ist noch folgendes aufgefallen. Im Abschnitt:

” Hatten wir in den 90er Jahren einen Durchschnittsertrag von > 500 kWh pro m², was auch auf wenig Erfahrungen und oftmals verschattete Dächer oder schlechte Dachausrichtungen zurückzuführen war. Bei guten Anlagen betrug der eher 700 kWh pro Jahr”

Sollte es wahrscheinlich 500 kWh/a/kWp bzw. 700 kWh/a/kWp heißen, sonst wäre seit den 90er ein deutlicher Rückschritt zu verzeichnen gewesen.

Aber eigentlich kann man den ganzen Abschnitt weglassen. Wen interessiert noch die Leistung von PV in den 90er?

Bei einem PV-Ertrag von 200 kWh/m²/a, was immer noch sehr gut ist, entspricht das einer Durchschnittsleistung von 23 W. Die Angabe von 15-20 W ist von daher nicht so falsch, als dass man folgendes schreiben kann:

“Das ist so hanebüchen, dass man hier klar sagen muss, hier soll uns bewusst die Unwahrheit erzählt werden.”

Hallo Heribert Haute, ich bleibe bei meiner Behauptung diese Zahlen haben gar keine Bedeutung. Hätten wir einen Mangel an Aufstellflächen oder Dachflächen, könnten sie eine Bedeutung bekommen. Das ist aber in Deutschland nicht gegeben um die Energiewende im Verbund mit Windenergie, Biomasse und Biogas, Wasserkraft, Solarthermie und Geothermie zu gestalten. In alle relevanten Studien dazu lässt sich hier keine Problembeschreibung finden.

Sonnige Grüße

Pingback: Gegenwindfakten | blog.doerflinger.org

Interessante Blase auf die ich gerade gestoßen bin!

Der verschwindend geringe Fortschritt in den letzten 10 Jahren lässt sich einfach nicht leugnen auch wenn manches Argument nicht korrekt ist.

Vielleicht sollten die Herrn auch mal Sinn lesen oder einfach von Ihren wir retten Deutschland und danach die Welt Allmachtsphantasien abstand nehmen!

Die verhasse Öl- und Gasheizung im Keller wandelt die Energie mit sehr hohem Wirkungsgrad um. So dass Ihr Argument mit Hinblick auf die Primärenergie ebenso nicht ganz korrekt ist.

Selbst meine 25 Jahre alten Niedertemperaturkessel haben 90% therm. Wirkungsgrad….

Wahrscheinlich firmiert der Autor auch unter dem Pseudonym “Reinhard Habichtsberg”…

Hallo Stefan,

Was die Blas mit den Atomprofs. angeht geb ich ihnen recht und möglicherweise gehören die dann wohl auch zu denen die die Technologieoffenheit fordern, so wie man es heut immer wieder zu hören bekommt. Was Öl oder Gaskessel betrifft, sind deren Wirkungsgrade ja auch oft sehr hoch, wie ihrer. Nur wir wollen ja mit der Energiewende weg von Öl und Gas. Da bleibt, und das ist ja auch so geplant dann die Elektrizität. Und dann bietet sich immer eine Wärmepumpe an. Eiserne Vertreter dieses Weges die dan aber eine Luftwärmepumpe verbauen werden ihre Kunden aber gerade in den sehr kalten Tagen mit einer Wärmepumpe zurücklassen, deren Wirkungsgrad dann einer elektrischen Heizung zu vergleichen ist. ! kWh Strom sind dann 1 kWh Heizleistung. Das ist nicht so geschickt, weil solche Wärmepumpen bei Temperaturen über Null erst effektiv sind und mit eine Kilowattstunde Strom dann drei oder mehr Kilowattstunden Wärme produzieren. Auch die Überlegung mit synthetischen Kraftstoffen zu heizen halte ich für falsch. Die nämlich werden auch mit einem schlechten Wirkungsgrad bei der Herstellung herkommen. Aber es gibt durchaus Lösungen und wir werden darüber berichten. Versprochen.

Sonnige Grüße

Klasse Analyse!